A simple framework for contrastive learning of visual representations. (PMLR 2020)

- 연구 기관: Google Brain, U. of Toronto

- 저자 : Chen, T., Kornblith, S., Norouzi, M., & Hinton, G. (2020, November).

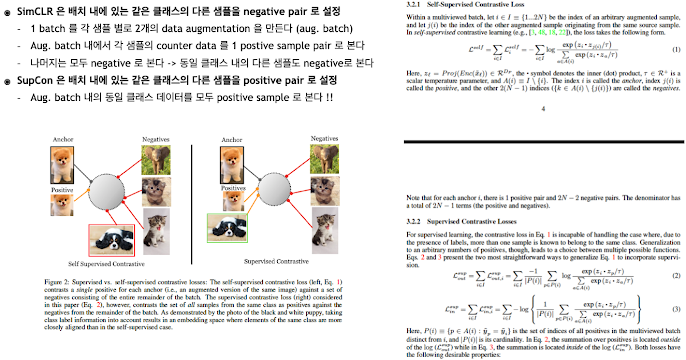

Contrastive learning 의 기본 개념은 "intra-class feature distance"는 작게, "inter-class distance"는 크게 만드는 것이다. 본 논문은 encoder feature 를 그대로 쓰지 않고, encoder feature 를 조금 더 작은 차원의 projection feature 로 매핑 시킨 후, projection feature 를 대상으로 contrastive loss 를 정의하고 학습시켰다.

저자들은 본 기술을 SimCLR 로 명명하고 있다.